Data publikacji: 17-12-2025 | Data aktualizacji: 17-12-2025 | Autor: Piotr Kurpiewski

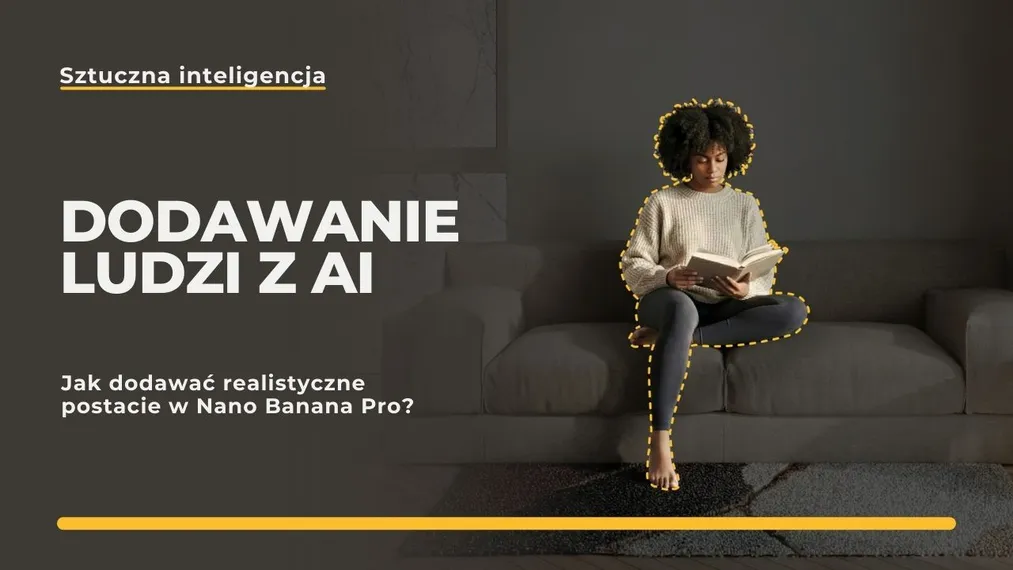

Ludzie w wizualizacjach: jak dodawać realistyczne postacie w Nano Banana Pro?

Masz dość wklejonych, lewitujących postaci w swoich wizualizacjach? Zobacz, jak Nano Banana Pro rozwiązuje ten problem, generując ludzi z idealnym cieniem i oświetleniem. W tym artykule przeczytasz o metodach na szybkie dodawanie tzw. sztafażu na podstawie prostej instrukcji tekstowej oraz wstawianie konkretnych sylwetek do wnętrz (np. inwestora). Poznasz też triki na uzyskanie architektonicznego efektu motion blur i zobaczysz, jak jednym kliknięciem zamienić statyczny obraz w wideo dzięki modelowi Google Veo.

Masz idealny render. Światło gra na posadzce, materiały są fotorealistyczne, kompozycja bez zarzutu. Czas na ostatni szlif – sztafaż, czyli dodanie ludzi (choć może nie tak małych jak w tradycyjnej technice staffage). Otwierasz Photoshopa, wklejasz postać z popularnej biblioteki "cutout people" i… czar pryska. Postać wygląda płasko, lewituje nad podłogą, a cień pada w inną stronę niż w reszcie sceny.

Brzmi znajomo? To odwieczny problem wizualizatorów. Na szczęście sztuczna inteligencja zmienia zasady gry. Nano Banana Pro nie "wkleja" ludzi – on ich generuje wewnątrz trójwymiarowej przestrzeni zdjęcia. W tym artykule pokażę Ci, jak zaludniać swoje wizualizacje, zachowując perfekcyjny realizm, jak wstawiać konkretne sylwetki, a nawet jak wprawić je w ruch za pomocą modelu wideo Veo.

Jeśli chcesz najpierw dowiedzieć się, jak edytować same meble i wystrój, sprawdź mój poprzedni poradnik: Homestaging z AI: Jak zmienić wystrój wnętrza na gotowym zdjęciu?.

Dlaczego wklejanie ludzi w Photoshopie to przeszłość?

Tradycyjna metoda postprodukcji wymaga ogromnej wprawy. Aby wklejona dwuwymiarowa postać (2D) wyglądała dobrze w trójwymiarowej scenie (3D), musisz ręcznie domalować cień kontaktowy (tam, gdzie buty stykają się z podłogą), dopasować temperaturę barwową postaci do oświetlenia wnętrza i często dodać sztuczne rozmycie.

Nano Banana Pro robi to automatycznie. Model rozumie geometrię Twojego renderu. Wie, gdzie jest źródło światła (np. okno) i generuje postać, która rzuca cień we właściwym kierunku. Co więcej, światło otula sylwetkę, tworząc naturalne refleksy na ubraniu czy skórze. To koniec efektu "papierowej makiety".

ZOBACZ NASZE KURSY ZE SZTUCZNEJ INTELIGENCJI

Szybkie ożywienie sceny - metoda "z promptu"

To najszybszy sposób na wypełnienie pustego kadru, idealny na etapie koncepcji. Załóżmy, że masz gotową wizualizację salonu, ale brakuje w niej życia. Nie zależy Ci na konkretnym wyglądzie osoby, chcesz po prostu kogoś, kto czyta książkę.

Wgrywasz swój render do interfejsu (Gemini lub Google AI Studio) i wpisujesz prompt:

"Add a young woman sitting on the sofa, reading a book. She is wearing casual home clothes. Soft natural lighting from the window, realistic shadows on the sofa."

AI analizuje perspektywę kanapy i sadza na niej postać. Zwróć uwagę na to, jak poduszki uginają się pod ciężarem sylwetki – to detal, który w Photoshopie wymagałby zaawansowanego retuszu (chociażby z wykorzystaniem narzędzia Liquify), a tutaj dzieje się sam.

Wstawianie konkretnych sylwetek – inwestor we własnym salonie

A co, jeśli chcesz wstawić konkretną osobę? Na przykład inwestora, który chce zobaczyć siebie w swoim przyszłym biurze, albo masz przygotowany zestaw ulubionych sylwetek (np. wygenerowanych wcześniej), które pasują do Twojego stylu?

Tutaj wykorzystujemy multimodalność modelu. Proces wygląda tak:

- Wgrywasz wizualizację wnętrza (jako bazę).

- Dodajesz zdjęcie sylwetki/osoby na neutralnym tle (jako referencję).

- Stosujesz prompt wiążący:

"Using the reference images, place the woman from the second image into the living room. She should be standing by the window, looking outside. Match the lighting and shadows to the scene."

Ważna uwaga: Nano Banana Pro świetnie radzi sobie z przeniesieniem ogólnej sylwetki, stylu ubioru i postawy. Nie jest to jednak narzędzie typu deepfake do idealnego kopiowania twarzy (tzw. face swap). Twarz może być bardzo podobna, ale model priorytetyzuje spójność oświetleniową nad biometryczną zgodnością. Do celów wizualizacji architektonicznej jest to w zupełności wystarczające.

Motion blur i ludzie-duchy – pro tipy dla architektów

W profesjonalnej fotografii architektury i wizualizacjach często unika się pokazywania ostrych twarzy, aby nie odwracały uwagi od projektu. Stosuje się wtedy długi czas naświetlania, zamieniając ludzi w rozmyte "duchy". Czy AI to potrafi?

Oczywiście! I robi to genialnie. Wystarczy dodać w prompcie odpowiednie polecenia:

- Efekt ruchu, dzięki któremu uzyskasz dynamiczne smugi:

"Add people walking in the background with strong motion blur effect. Long exposure photography style."

- Anonimowość. Postać od tyłu buduje klimat tajemniczości i pozwala widzowi utożsamić się z nią, nie narzucając konkretnych rysów twarzy.

"A silhouette of a person standing back to the camera, looking at the view."

Etyka i bezpieczeństwo – o czym pamiętać?

Korzystając z modeli od Google, musisz pamiętać o wbudowanych filtrach bezpieczeństwa. Model może odmówić wygenerowania fotorealistycznej twarzy znanej osoby publicznej lub treści, które uzna za nieodpowiednie. To zabezpieczenie przed tworzeniem fake newsów.

Jako projektanci powinniśmy też pamiętać o różnorodności. W międzynarodowych konkursach architektonicznych standardem jest pokazywanie społeczeństwa w całym jego spektrum. Warto uwzględniać to w promptach, dbając o reprezentację różnych grup wiekowych i etnicznych, co dodaje projektom autentyczności.

Ożyw swoje wizualizacje z Google Veo!

Skoro masz już statyczny obraz z idealnie wpasowaną postacią, dlaczego nie pójść krok dalej? Model Veo od Google to potężny model wideo, dostępny w tych samych ekosystemach co Nano Banana Pro (m. in. w interfejsie Gemini).

Możesz wgrać swoją finalną wizualizację jako klatkę początkową i wpisać prompt wideo:

"A cinematic video based on this image. The person sitting on the sofa is slowly turning pages of the book. The camera is steady."

Efekt? Otrzymujesz kilkusekundowe, wysokiej jakości wideo, w którym postać naprawdę się rusza, a światło pracuje w przestrzeni. To absolutny game changer w prezentacji projektów klientom, który pozwala Ci tworzyć animacje bez konieczności renderowania tysięcy klatek w V-Rayu.

Zostań mistrzem wizualizacji AI

Dodawanie ludzi i tworzenie wideo to techniki, które wyróżnią Twoje portfolio na tle konkurencji. Chcesz zobaczyć te workflows na żywo, otrzymać gotowe biblioteki promptów i nauczyć się pracy z modelami FLUX Kontext, Nano Banana oraz Veo? Jeśli tak, to konieczie zobacz nasz kurs wizualizacji i wideo AI - Nano Banana, FLUX Kontext, Veo itp. w architekturze i designie.

Przeczytaj o AI - Sztuczna inteligencja na naszym blogu

-

![GPT Image 1.5 vs Nano Banana Pro - porównanie generatorów grafik AI w 12 testach]()

GPT Image 1.5 vs Nano Banana Pro - porównanie generatorów grafik AI w 12 testach

GPT Image 1.5 vs Nano Banana Pro - 12 identycznych zadań, dwa generatory AI. Sprawdź, który wygrywa! -

![SketchUp i Nano Banana Pro: fotorealistyczne wizualizacje w 5 minut! Czy to koniec V-Raya?]()

SketchUp i Nano Banana Pro: fotorealistyczne wizualizacje w 5 minut! Czy to koniec V-Raya?

Koniec z wielogodzinnym renderingiem? Sprawdź, jak zamienić prosty model 3D w gotową wizualizację dzięki AI. Zobacz workflow krok po kroku! -

![Homestaging z AI: Jak zmienić wystrój wnętrza na gotowym zdjęciu w Nano Banana Pro?]()

Homestaging z AI: Jak zmienić wystrój wnętrza na gotowym zdjęciu w Nano Banana Pro?

Klient chce inną sofę na gotowym renderze? Nie renderuj od nowa! Zobacz, jak zrobić wirtualny homestaging z AI w 5 minut. -

![Nano Banana Pro w projektowaniu wnętrz - kompletny przewodnik z gotowymi promptami!]()

Nano Banana Pro w projektowaniu wnętrz - kompletny przewodnik z gotowymi promptami!

Czy to koniec ery V-Raya? Poznaj Nano Banana Pro i zobacz, jak tworzyć wizualizacje, meblować rzuty i edytować projekty w minuty!

Jakiego oprogramowania chcesz się nauczyć?

-

Sketchup

Liczba dostępnych kursów: 35

Łączny czas trwania kursów: 186 godzin![]()

-

3ds Max

Liczba dostępnych kursów: 28

Łączny czas trwania kursów: 322 godzin![]()

-

Archicad

Liczba dostępnych kursów: 27

Łączny czas trwania kursów: 143 godzin![]()

-

Revit

Liczba dostępnych kursów: 19

Łączny czas trwania kursów: 91 godzin![]()

Szukasz czegoś innego?